記事公開日

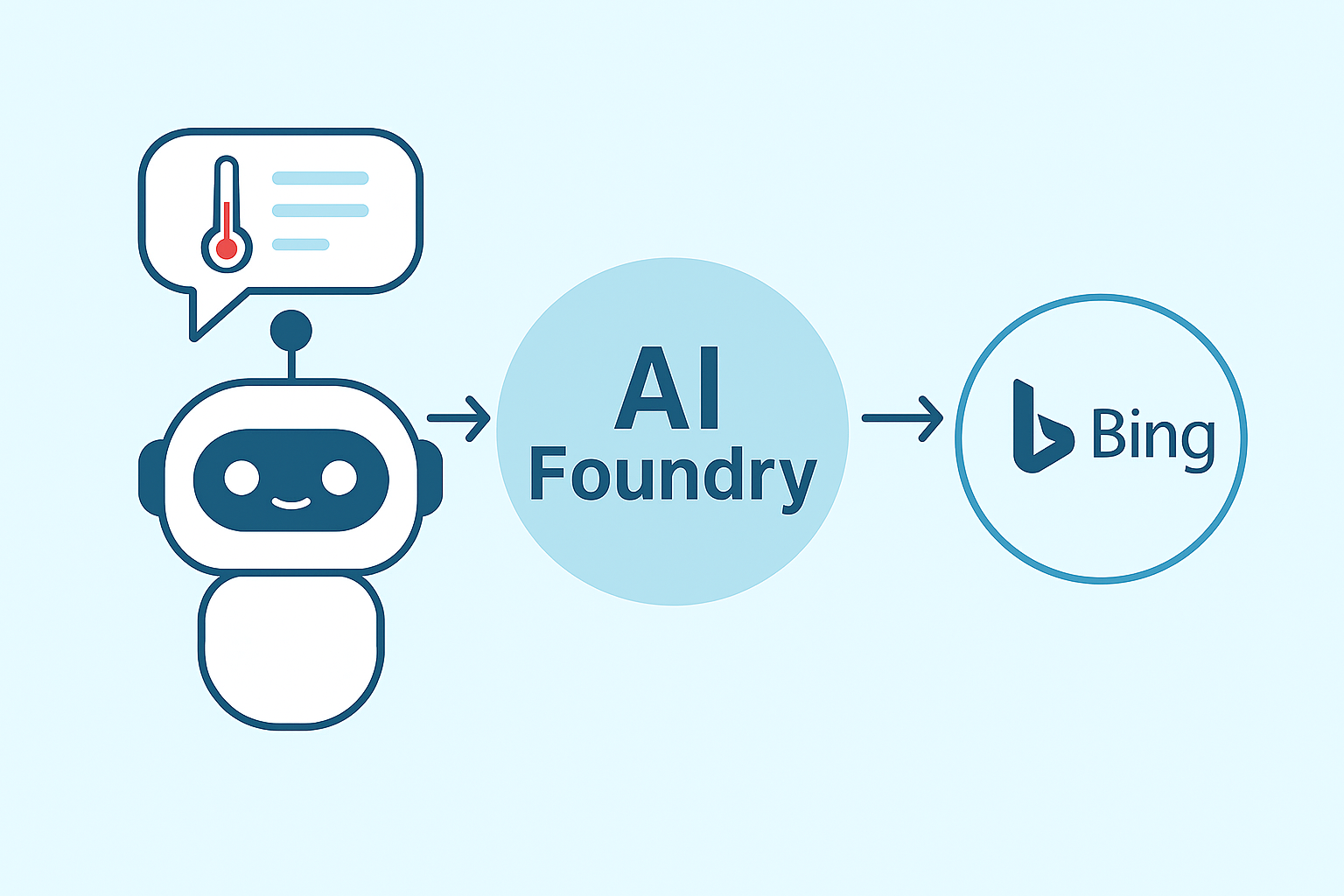

AI Foundry × Bing Grounding 実践ガイド

Bing Search廃止後のリアルタイム検索はどう実装する?

AIモデルの性能が向上する一方で、依然として「学習済み知識に閉じている」という制約があります。本記事では、MicrosoftのAI Foundry環境における Bing Grounding の活用方法を紹介します。

Bing Search APIが廃止された現在、リアルタイム検索をAIに組み込むにはどうすればよいのか?

その実装手順と注意点を、コード付きで解説します。

Bing Groundingとは:Bing Searchの後継機能

2025年8月、Bing Search APIは廃止されました。 その代替として登場したのが Bing Grounding です。これは単なる検索APIではなく、AIモデルが直接Bingの検索インデックスにアクセスし、リアルタイム情報を応答に組み込むための「AI最適化済み検索機能」です。

- AIモデルに統合された検索機能

- 自然言語での検索意図理解と結果取得

- 開発者が明示的にAPIを呼び出す必要なし

実践:AI FoundryでBing Groundingを使う手順

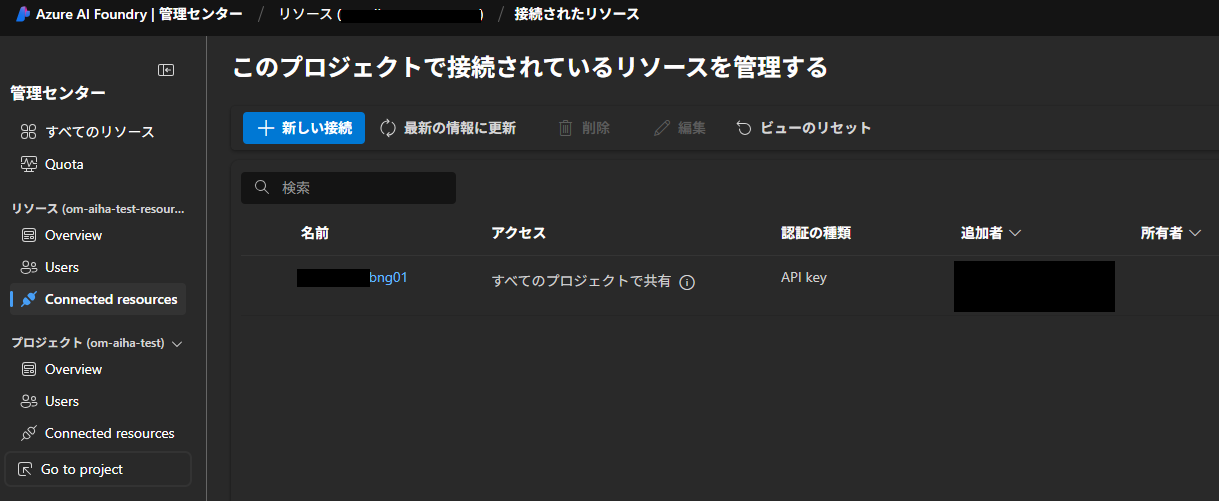

以下は、Azure AI FoundryでBing Groundingを追加し、Python SDKから呼び出すまでの流れです。①Azure AI Foundryリソースの作成と接続

- Azure AI FoundryポータルからAzure AI Foundryリソースを作成

- Bingリソースを作成

- Azure AI Foundry|管理センターのリソース-Connected resourcesから作成したBingリソースをプロジェクトに接続

※Bingリソースは Grounding用に利用されます。

②Bing GroundingをAgentに追加

Groundingは、Foundry内のAgentへ追加することで有効化されます。- Azure AI FoundryFoundryポータルでAgentで使用するモデルをデプロイ

- 新規Agentを作成

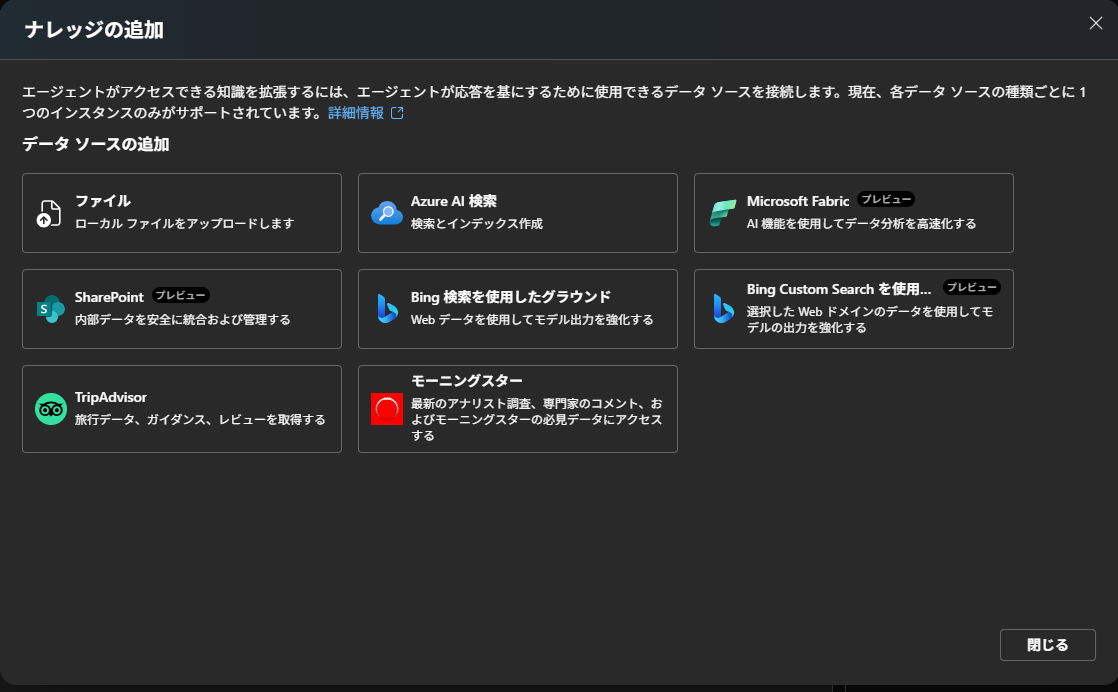

- Agent の「ナレッジの追加」から「Bing検索を使用したグラウンド」を追加

この設定により、Agentはユーザーの質問に対してBingを使ったリアルタイム検索を実行し、引用元を含む回答を生成します。

③Python SDKからのAgent呼び出し

from azure.identity import DefaultAzureCredential

from azure.ai.projects import AIProjectClient

from azure.ai.agents.models import ListSortOrder

# プロジェクトのエンドポイント(Project API endpoint)

# 形式: https://.services.ai.azure.com/api/projects/

project_endpoint = "<your procect endpoint>"

# クライアント初期化

project_client = AIProjectClient(

credential=DefaultAzureCredential(),

endpoint=project_endpoint,

)

agent_id = "<your agent id>"

# 1) スレッド作成

thread = project_client.agents.threads.create()

# 2) ユーザーメッセージ追加

project_client.agents.messages.create(

thread_id=thread.id,

role="user",

content="今日の日本の気温は?",

)

# 3) 実行(ラン)を作成して処理(AgentがBing検索などのツールを自律実行)

run = project_client.agents.runs.create_and_process(

thread_id=thread.id,

agent_id=agent_id,

)

if run.status == "failed":

raise RuntimeError(f"Run failed: {run.last_error}")

# 4) 応答メッセージの取得

messages = project_client.agents.messages.list(

thread_id=thread.id,

order=ListSortOrder.ASCENDING

)

# 最新のassistantレスポンスを抽出して表示

for m in reversed(list(messages)):

if m.role == "assistant":

# テキスト応答(引用や出典URLが含まれる場合あり)

if m.text_messages:

print(m.text_messages[-1].text.value)

break

【実行結果】

2025年9月19日の日本の気温は地域ごとに異なります。 - **北海道から北陸**では、晴天となり、快適な陽気が予想されています。札幌では最高気温23℃、仙台は25℃、金沢では28℃と見込まれています。 - **関東地方**は、昨日より大幅に気温が下がり、東京都心では最高気温が25℃、埼玉や宇都宮などの内陸部では26℃程度で、秋らしい涼しさとなるでしょう。 - **東海から九州地方**では、日差しが期待できるものの、最高気温は30~32℃前後と、まだ蒸し暑さが残る可能性があります【3:0†source】【3:1†source 】。 秋の訪れを感じつつ、地域により体感が異なる一日となりそうです。このように、Groundingが有効なAgentを通じて呼び出すことで、モデルはBing検索を活用し、最新情報に基づいた応答を返します。

ちなみにAgentにBing Groundingを追加しない場合だと以下のようにリアルタイムの情報を取得できない旨の回答となります。

私の環境ではリアルタイムの情報にアクセスすることができないため、今日の日本の気温を正確にお伝えすることはできません。しかし、お住まいの地域の気温や天気情報については、以下の方法で確認できます: 1. **インターネット検索**: 「〇〇(地域名)の今日の天気」と検索すると気温が確認できます。 2. **天気予報アプリ**: Yahoo!天気やWeathernewsなど、天気予報アプリで現在の気温を確認できます。 3. **テレビやラジオの天気予報**: 地元のニュースで最新の天気情報を得ることができます。 地域によって気温は異なるので、具体的な場所を教えていただければ、さらに詳しい方法をお伝えします!

補足:Groundingの効果

Bing Groundingを利用することで、以下のようなメリットがあります。- モデルがリアルタイム検索を実行し、最新情報に基づいた回答を生成

- 回答に引用元URLが含まれ、信頼性が向上

- FAQやニュース、天気、株価など、動的な情報への対応が可能

まとめ

いかがだったでしょうか。Bing Searchの廃止により、リアルタイム情報取得には Bing Grounding が必須となりました。

AI Foundryとの組み合わせにより、複雑なAPI連携を意識せず、自然な会話の中でリアルタイム情報を取得するAIエージェントを構築できます。

★ユーザー利用との違い★

ここで注意したいのは、ユーザーとして Copilot(GPT‑4o/5 搭載)を利用する場合は、Bing Grounding が標準で統合されているため、自動的にリアルタイム検索が行われるという点です。

一方で、開発者が GPT‑4o/5 を Azure AI Foundry などで利用する場合は、明示的に Bing Grounding を組み込まない限りリアルタイム検索は行われません。

この違いを理解しておくことで、「ユーザー体験」と「開発環境での挙動」のギャップを正しく把握できます。

QESでは、「AIチャットボット構築サービス」をはじめとして、各AIサービスを利用したシステム導入のお手伝いをしております。それ以外でも様々なアプリケーションの開発・導入を行っております。提供するサービス・ソリューションにつきましては こちら に掲載しております。

システム開発・構築でお困りの問題や弊社が提供するサービス・ソリューションにご興味を抱かれましたら、是非一度 お問い合わせ ください。

※このブログで参照されている、Microsoft、Azure OpenAI、その他のマイクロソフト製品およびサービスは、米国およびその他の国におけるマイクロソフトの商標または登録商標です。

※その他の会社名、製品名は各社の登録商標または商標です。